¿Qué pasará si la IA provoca un shock en el empleo?

Miguel Ángel Valero

El Banco de Inglaterra estudia realizar simulaciones de crisis o pruebas de resistencia, los llamados stress tests en la jerga financiera, para analizar qué ocurriría en la economía británica si la inteligencia artificial (IA) provocara un shock en el empleo y en el tejido empresarial. El banco central anticipar qué pasaría si la adopción masiva de esta tecnología destruye millones de puestos de trabajo, reduce la capacidad de pago de familias y empresas y termina trasladando ese impacto al sistema financiero.

No se trata de ciencia ficción ni de un ejercicio teórico. Es planificación económica. El Banco de Inglaterra quiere entender cómo reaccionaría el conjunto de la economía si se produjera una transformación tecnológica de gran escala. Y el simple hecho de que un banco central esté planteándose estos escenarios dice mucho sobre la magnitud del cambio que algunos economistas creen que se avecina.

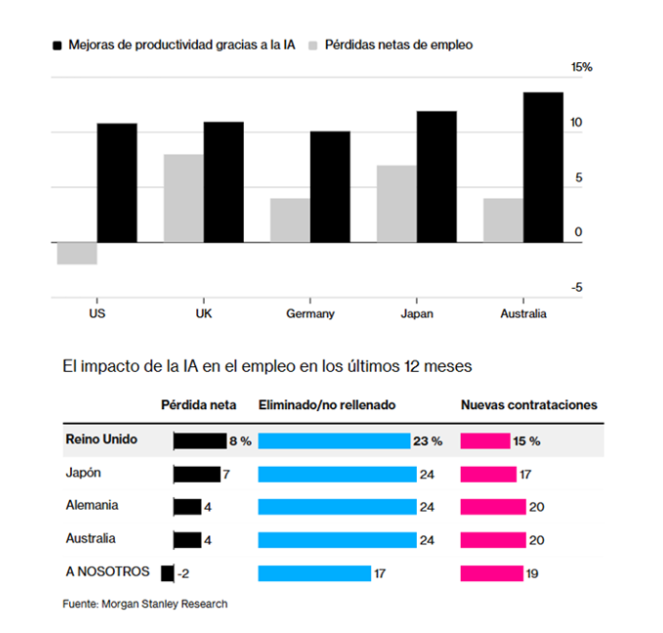

El debate se ha intensificado después de que el CEO de Anthropic, Dario Amodei, advirtiera que la inteligencia artificial podría sustituir hasta el 50% de los empleos administrativos de nivel inicial en los próximos cinco años. Puede parecer una previsión extrema, pero empiezan a aparecer señales que alimentan esa preocupación. La empresa tecnológica Block anunció un recorte cercano al 50% de su plantilla citando explícitamente la adopción de inteligencia artificial como uno de los factores clave. Y su fundador, Jack Dorsey, advertía que muchas otras compañías terminarán siguiendo ese mismo camino.

En Reino Unido, la Oficina de Responsabilidad Presupuestaria ha calculado que el desplazamiento tecnológico provocado por la IA podría añadir medio millón de desempleados adicionales sin generar necesariamente más crecimiento económico. Ese escenario implicaría más gasto público, más endeudamiento y tensiones sociales importantes. Por eso el Banco de Inglaterra quiere analizar con calma posibles escenarios extremos: qué pasaría con los préstamos de familias y empresas, cómo se comportarían los mercados financieros o qué impacto macroeconómico tendría una adopción masiva de esta tecnología.

La coyuntura y la situación geopolítica convulsa (como las guerras comerciales por los aranceles, y los conflictos armados por el petróleo, como los ataques de EEUU e Israel a Irán o el asalto de Trump a Venezuela) pueden estar distrayendo la atención de lo que realmente será el gran cambio estructural de las próximas décadas: la inteligencia artificial. El verdadero desafío económico no estará en las tensiones comerciales entre países, sino en la destrucción de empleo y en las transformaciones profundas que esta tecnología puede provocar en el mercado laboral.

El economista jefe del Banco de Inglaterra, Huw Pill, cree que el escenario más probable no es necesariamente una economía peor. De hecho, es posible que la riqueza agregada aumente gracias a los avances tecnológicos y a la mejora de la productividad. El problema es cómo se distribuirá esa riqueza. La IA podría generar un mundo en el que, en promedio, todos sean más ricos, pero donde las diferencias entre quienes se benefician de la tecnología y quienes quedan desplazados se amplíen considerablemente. Algo que ya ocurrió en otras grandes transformaciones económicas, desde la revolución industrial hasta la globalización.

Por eso algunos gobiernos empiezan a discutir ideas que hasta hace poco parecían casi utópicas: desde programas masivos de reconversión laboral hasta nuevas formas de redistribución fiscal o incluso la posibilidad de implantar una renta básica universal en los sectores más afectados por la automatización. No significa que esas políticas se vayan a aplicar mañana, pero el simple hecho de que estén sobre la mesa demuestra que algunos países están empezando a pensar seriamente en cómo gestionar una transición tecnológica que podría ser muy abrupta.

También las empresas se están moviendo en esa dirección. En la junta de accionistas de Mapfre se dedicó un apartado destacado a la IA, mencionando expresamente los procesos de reciclaje profesional y apoyo para nuevas tareas (más de 4.500 empleados han recibido formación en IA). "La mejor IA es la que multiplica el valor de las personas, a la vez que hace a la compañía más productiva, eficiente y cercana", aseguraba su presidente, Antonio Huertas. En apenas un año de existencia, el Centro de IA del grupo ha desarrollado más de 150 casos de uso. "Nos hemos comprometido públicamente a que no usaremos la IA para acometer reducciones de plantilla, sino para mejorar las capacidades de nuestros empleados y colaboradores", señala José Manuel Inchausti, vicepresidente 1º del grupo asegurador.

Y aquí aparece una reflexión incómoda. Mientras en algunos países bancos centrales, universidades y gobiernos analizan escenarios de disrupción tecnológica, en España el debate público, salvo algunas excepciones, sigue centrado casi exclusivamente en el corto plazo. La política gira alrededor de conflictos partidistas, cálculos electorales y estrategias para conservar o alcanzar el poder. Sin embargo, apenas se discute sobre los cambios estructurales que podrían afectar de forma profunda al mercado laboral en los próximos años.

Y eso debería preocuparnos. Porque si algo nos enseña la historia económica es que "las revoluciones tecnológicas no esperan a que los países estén preparados. Simplemente ocurren. La revolución industrial hizo desaparecer profesiones enteras y creó otras nuevas. Internet transformó sectores completos y cambió la forma en la que trabajamos, consumimos y nos comunicamos. Y todo apunta a que la inteligencia artificial puede provocar un cambio aún más profundo", advierte el analista Pablo Gil en The Trader.

El verdadero problema, por tanto, no es que la IA vaya a transformar la economía. Eso parece inevitable. El verdadero riesgo es no prepararse para ello. Los países que anticipen el cambio podrán adaptar su sistema educativo, su mercado laboral y sus políticas económicas. Los que no lo hagan simplemente reaccionarán cuando el impacto ya sea inevitable. Y entonces gestionar las consecuencias será mucho más difícil.

"Quizá dentro de unos años miremos atrás y entendamos que el gran debate económico de esta década no eran los aranceles, ni las guerras comerciales, ni las tensiones políticas del momento. Quizá el verdadero cambio que estaba empezando a gestarse era otro mucho más profundo: una transformación radical del trabajo, de la productividad y del propio funcionamiento del sistema económico. La pregunta que deberíamos hacernos no es si ese cambio llegará. La pregunta es si estaremos preparados cuando lo haga", insiste este experto.

Las lecciones del caso Anthropic

La decisión de Donald Trump de ordenar a todas las agencias federales que dejen de utilizar la tecnología de Anthropic no es solo un episodio más en la batalla cultural estadounidense. Es una señal de advertencia para el mercado. El detonante ha sido la negativa de Anthropic a permitir determinados usos de su IA por parte del Pentágono, especialmente en ámbitos como la vigilancia masiva de ciudadanos estadounidenses y el desarrollo de drones autónomos armados. La compañía defendió que esos usos cruzaban una línea ética y tecnológica que no estaba dispuesta a traspasar. La respuesta presidencial fue fulminante: ruptura de contratos, orden de desconexión progresiva y amenaza de designarla como riesgo para la seguridad nacional. Lo verdaderamente relevante no es el choque ideológico. Es el precedente que se crea.

Aquí es donde entra en juego el movimiento de Sam Altman y OpenAI, y es precisamente ahí donde surge la mayor sorpresa del mercado. OpenAI anunció rápidamente un acuerdo para desplegar sus modelos en la red clasificada del Departamento de Defensa, ocupando el espacio que dejaba Anthropic. Hasta ahí, podría parecer simplemente una jugada competitiva. Pero el matiz es clave: Altman afirmó públicamente que OpenAI mantiene exactamente las mismas líneas rojas que defendía Anthropic: no permitir el uso de su tecnología para vigilancia masiva nacional ni para sistemas de armas letales autónomas sin supervisión humana. Entonces, ¿qué cambia?

Si ambas compañías comparten los mismos límites éticos, el desenlace resulta desconcertante. O bien el Gobierno ha aceptado con OpenAI lo que negó a Anthropic (lo que plantearía dudas sobre la coherencia del conflicto) o bien las condiciones reales del acuerdo no son exactamente las mismas. En ambos casos, la sensación que se transmite al mercado es de opacidad y discrecionalidad. Y eso es lo que introduce un nuevo riesgo.

Hasta ahora, el gran debate en torno a la inteligencia artificial era si las inversiones multimillonarias en centros de datos, chips y energía generarían retornos suficientes. Ahora se suma una variable adicional: el alineamiento político como factor determinante para acceder a contratos estratégicos. No hablamos de una regulación clara y previsible. Hablamos de decisiones ejecutivas que pueden alterar de forma drástica el posicionamiento competitivo de una empresa de un día para otro. Si el mensaje implícito al sector es que la relación con el poder puede pesar tanto como la superioridad tecnológica, la prima de riesgo cambia. Porque entonces el valor ya no depende solo de innovación, cuota de mercado o ventajas competitivas, sino también de la estabilidad institucional y de la cercanía al Ejecutivo.

El episodio de Anthropic/OpenAI marca un antes y un después. Durante años hemos analizado a las grandes tecnológicas como si operaran en un entorno casi autónomo, donde el riesgo principal era el ciclo económico o la competencia. Pero cuanto más estratégicas se vuelven (especialmente en defensa y seguridad nacional) más expuestas están al poder político. Y lo más inquietante no es que el Gobierno castigue a una empresa. Lo más inquietante es que otra ocupe su lugar defendiendo públicamente los mismos principios y, aun así, el acuerdo salga adelante. Eso deja una pregunta flotando en el aire: ¿cuál fue realmente la línea roja? ¿La ética declarada… o la relación con el poder?

"Creo que el mercado todavía no ha interiorizado del todo lo que implica este episodio. No estamos hablando de una simple disputa contractual. Estamos hablando de la señal que se envía a todo un sector que concentra una parte enorme del crecimiento esperado para la próxima década. Si las compañías tecnológicas entienden que su acceso a contratos estratégicos puede depender de decisiones políticas cambiantes, ajustarán su comportamiento. Y si los inversores perciben que la seguridad jurídica es menos sólida de lo que pensaban, ajustarán sus valoraciones", explica Pablo Gil.

La inteligencia artificial seguirá avanzando. Las inversiones seguirán llegando. Pero el entorno ya no es el mismo. Cuando el poder ejecutivo demuestra que puede alterar el tablero competitivo en cuestión de horas, la ecuación riesgo-rentabilidad cambia. Y en un momento en el que ya empiezan a surgir dudas sobre el retorno real de las gigantescas inversiones en IA, añadir incertidumbre política a la ecuación puede ser el factor que transforme la euforia en prudencia. Porque al final, lo que más penaliza el mercado no es el riesgo conocido. Es la sensación de que las reglas pueden cambiar en cualquier momento.

La oportunidad de la Artificial General Intelligence

Por otra parte, en el mundo de la inteligencia artificial hay una palabra que se repite constantemente: AGI, o Artificial General Intelligence. En teoría, se refiere a una inteligencia artificial capaz de hacer todo lo que puede hacer un ser humano, en cualquier campo: pensar, razonar, aprender, crear, decidir. Muchos líderes del sector creen que ese momento está cerca. Sam Altman, CEO de OpenAI, ha llegado a sugerir que podríamos verla antes de 2030.Pero no todo el mundo está de acuerdo.

Uno de los grandes referentes históricos del sector, Yann LeCun (considerado uno de los 'padrinos' de la IA), plantea una reflexión muy interesante: quizá estamos persiguiendo el objetivo equivocado. Según LeCun, la idea de una IA artificial completamente generalista puede no ser ni necesaria ni realista. Y propone una alternativa que cambia el enfoque: lo importante no es que una máquina sepa hacerlo todo, sino lo rápido que puede aprender cosas nuevas. A esto lo llama Superhuman Adaptable Intelligence (Inteligencia Adaptable Superhumana).

La idea es bastante sencilla si la comparamos con cómo funcionan los humanos. Tenemos la capacidad de aprender prácticamente cualquier cosa: tocar un instrumento, programar, cocinar o pilotar un avión. Pero nadie sabe hacerlo todo. Cada persona se especializa en ciertas áreas y aprende nuevas habilidades cuando las necesita. Con la inteligencia artificial podría ocurrir algo parecido.

En lugar de intentar construir un único sistema que lo sepa todo desde el principio, el objetivo sería crear modelos capaces de adaptarse muy rápido a nuevas tareas, aprender con pocos ejemplos y aplicar lo que ya saben a problemas distintos. En otras palabras: no una IA que lo sepa todo, sino una IA que pueda aprender casi cualquier cosa rápidamente.

Mientras tanto, el debate en el sector sigue abierto. Algunos investigadores incluso empiezan a plantear otra pregunta inquietante: si estas máquinas podrían llegar a desarrollar algún tipo de conciencia. Pero quizá la cuestión más importante no es cuándo llegará la AGI, sino algo más práctico. Porque, mientras discutimos sobre el futuro, ya tenemos delante sistemas de inteligencia artificial mucho más potentes de lo que la mayoría de empresas y profesionales saben utilizar. Y ahí es donde probablemente está la verdadera oportunidad de los próximos años.